2 augustus 2026. Over vijf maanden.

Dan worden de regels voor hoogrisico AI-toepassingen van kracht. Niet als concept, niet als voorstel — als wet. Met boetes tot €35 miljoen of 7% van je wereldwijde omzet.

Als je AI gebruikt voor recruitment, kredietbeoordeling, of geautomatiseerde besluitvorming? Dan heb je werk te doen.

Maar geen paniek. De AI Act raakt het MKB anders dan grote corporates. In dit artikel leg ik uit wat er precies verandert, welke toepassingen eronder vallen, en wat je concreet moet regelen. Plus: hoe ik mijn eigen AI-systemen zo heb ingericht dat compliance er vanaf dag één in zit.

Wat is de AI Act?

De AI Act is de Europese verordening voor kunstmatige intelligentie. Denk aan de AVG, maar dan voor AI. Het is de eerste wet ter wereld die AI reguleert op basis van risico.

De kern is simpel: hoe groter het risico dat een AI-systeem vormt voor mensen, hoe strenger de eisen.

De wet werkt met vier risicolagen:

- Verboden — AI die mensen manipuleert, social scoring, of realtime gezichtsherkenning in openbare ruimtes. Dit is al verboden sinds februari 2025.

- Hoog risico — AI in recruitment, kredietbeoordeling, onderwijs, kritieke infrastructuur. Hier gelden strenge eisen vanaf augustus 2026.

- Transparantieplicht — Chatbots, deepfakes, AI-gegenereerde content. Gebruikers moeten weten dat ze met AI te maken hebben.

- Minimaal risico — Spamfilters, aanbevelingssystemen, de meeste AI-tools die je dagelijks gebruikt. Geen extra verplichtingen.

De meeste MKB-bedrijven vallen in de laatste twee categorieën. Maar check het goed — want een AI-tool voor HR of financiën kan zomaar in de hoogrisico-categorie vallen.

Wat verandert er in augustus 2026?

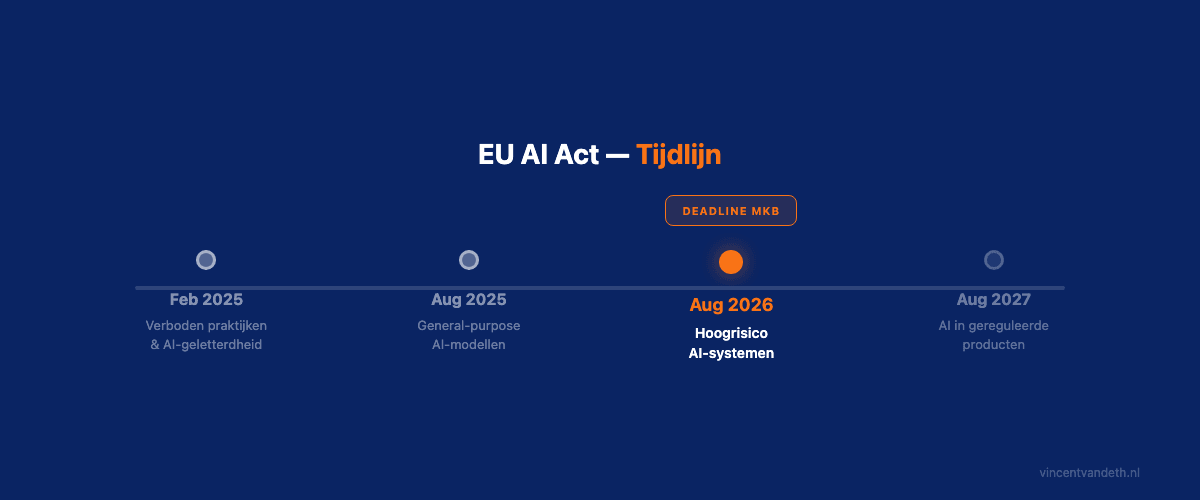

De AI Act treedt gefaseerd in werking. Dit is de tijdlijn:

- 2 februari 2025 — Verboden AI-praktijken en AI-geletterdheid (al actief)

- 2 augustus 2025 — Regels voor general-purpose AI-modellen (zoals ChatGPT, Claude)

- 2 augustus 2026 — Eisen voor hoogrisico AI-systemen en transparantieverplichtingen

- 2 augustus 2027 — Eisen voor AI als veiligheidscomponent in gereguleerde producten (medische apparatuur, machines)

De deadline van augustus 2026 is de belangrijkste voor het MKB. Vanaf dat moment moet elk hoogrisico AI-systeem voldoen aan strenge eisen rondom documentatie, risicobeheer, menselijk toezicht, en datakwaliteit.

Belangrijk detail: Nederland verwacht de nationale implementatiewet pas in Q4 2026. De Europese verordening geldt echter rechtstreeks — je kunt je niet verschuilen achter het ontbreken van nationale wetgeving.

Welke AI-toepassingen vallen onder hoogrisico?

Dit is waar het concreet wordt. De AI Act heeft een lijst (Annex III) met acht domeinen waarin AI-toepassingen automatisch als hoogrisico gelden.

Voor MKB-bedrijven zijn deze het meest relevant:

Werving en HR

Gebruik je AI om cv's te screenen, kandidaten te ranken, of sollicitatiegesprekken te analyseren? Hoogrisico. Dit geldt ook als je een tool van een derde partij gebruikt — je bent als "deployer" (gebruiksverantwoordelijke) medeverantwoordelijk.

Kredietbeoordeling en verzekeringen

AI die kredietwaardigheid beoordeelt of verzekeringsrisico's inschat? Hoogrisico. Denk aan geautomatiseerde financiële beslissingen die direct impact hebben op mensen.

Toegang tot diensten

AI die bepaalt of iemand toegang krijgt tot publieke diensten, uitkeringen, of essentiële diensten? Hoogrisico.

Biometrische identificatie

Gezichtsherkenning, emotieherkenning, of andere biometrische systemen op de werkvloer? Hoogrisico (en deels verboden).

Onderwijs

AI die examens beoordeelt, studenten selecteert, of leerpaden bepaalt? Hoogrisico.

De valkuil: veel MKB'ers denken "ik gebruik alleen ChatGPT, dit geldt niet voor mij." Maar als je ChatGPT hebt ingebouwd in een proces dat geautomatiseerd beslissingen neemt over mensen — sollicitanten, klanten, medewerkers — dan kan het wél als hoogrisico gelden.

Lees ook: AI agents voor het MKB: wat werkt echt in 2026? — een overzicht van welke AI-toepassingen vandaag al waarde leveren.

Wat moet je als MKB'er regelen?

Als je hoogrisico AI-systemen gebruikt (als "deployer"), gelden deze verplichtingen:

1. AI-register aanleggen

Breng in kaart welke AI-tools je gebruikt, waarvoor, en door wie. Klinkt simpel, maar de meeste bedrijven hebben geen overzicht. Start met een spreadsheet:

| Tool | Functie | Proces | Beslissing over mensen? | Risicoklasse |

|---|---|---|---|---|

| HireVue | Video-screening | Recruitment | Ja | Hoog risico |

| ChatGPT | Teksten schrijven | Marketing | Nee | Minimaal |

| Mollie AI | Fraude-detectie | Betalingen | Ja | Check nodig |

2. Risicobeoordeling uitvoeren

Voor elke hoogrisico-toepassing: documenteer welk risico het systeem vormt, welke data het gebruikt, en hoe je dat risico beheert.

3. Menselijk toezicht inrichten

De AI Act eist "human oversight" — een mens moet kunnen ingrijpen bij geautomatiseerde beslissingen. Geen AI die autonoom beslist over mensen zonder menselijke controle.

4. Documentatie bijhouden

Technische documentatie, gebruiksaanwijzingen, logs van beslissingen. De bewaartermijn voor hoogrisico systemen is 10 jaar.

5. Leveranciers checken

Koop je AI-software in? Vraag je leverancier om bewijs van conformiteit: CE-markering, registratie in de EU-database, technische documentatie. Als zij niet compliant zijn, heb jij een probleem.

6. AI-geletterdheid waarborgen

Dit geldt al sinds februari 2025: iedereen die met AI werkt moet voldoende kennis hebben om het verantwoord te gebruiken. Geen certificaat nodig, maar wel aantoonbare training.

Checklist: is jouw AI-gebruik compliant?

Dit is de checklist die ik zelf hanteer voor elk AI-systeem dat ik bouw. Je kunt hem gebruiken als startpunt voor je eigen inventarisatie:

- [ ] Inventarisatie compleet — alle AI-tools in kaart gebracht met functie en risicoklasse

- [ ] Beslissingen over mensen? — per tool gecontroleerd of er geautomatiseerde beslissingen over individuen worden genomen

- [ ] Menselijk toezicht ingericht — bij hoogrisico: een mens kan ingrijpen voordat een beslissing effect heeft

- [ ] Logging actief — elke AI-actie wordt gelogd met timestamp, input, output en beslissing (in mijn systeem via een NDJSON receipt ledger)

- [ ] Datakwaliteit geborgd — de data waarop de AI traint of beslist is gecontroleerd op bias en actualiteit

- [ ] Leverancier gecheckt — verwerkersovereenkomst getekend, conformiteitsverklaring opgevraagd

- [ ] AI-geletterdheid — iedereen die met AI werkt begrijpt wat het doet en wat de beperkingen zijn

- [ ] Documentatie up-to-date — technische beschrijving, gebruiksprotocol, en risicoanalyse bijgewerkt

Boetes: wat riskeer je?

De boetestructuur is gelaagd:

- Verboden AI-praktijken: tot €35 miljoen of 7% van de wereldwijde jaaromzet

- Hoogrisico-overtredingen: tot €15 miljoen of 3% van de wereldwijde jaaromzet

- Onjuiste informatie aan toezichthouders: tot €7,5 miljoen of 1,5% van de omzet

Voor MKB geldt: boetes worden proportioneel toegepast. Een bedrijf met 20 medewerkers krijgt geen boete van €35 miljoen. Maar de Autoriteit Persoonsgegevens (die waarschijnlijk het toezicht krijgt) kan wél flink ingrijpen als je helemaal niets hebt geregeld.

Het echte risico voor MKB is niet de megaboete. Het is het reputatierisico en het verlies van klantvertrouwen als blijkt dat je onzorgvuldig met AI omgaat.

Compliance-by-design: hoe ik het aanpak

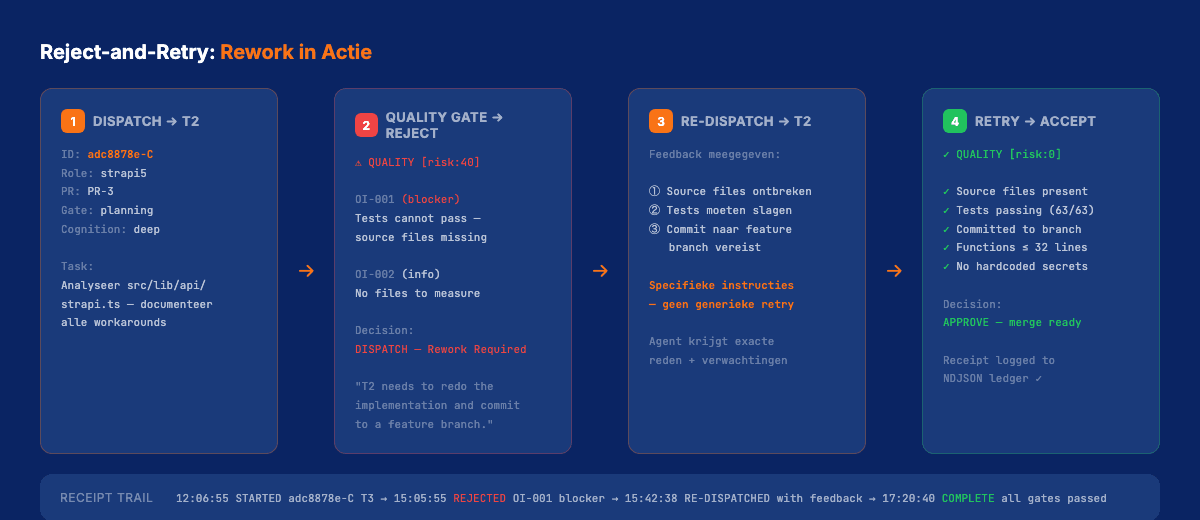

Ik bouw AI-systemen voor MKB-bedrijven. Mijn aanpak is dat compliance er niet achteraf bij komt, maar er vanaf het begin in zit.

Glass-box governance

Elk AI-agent-systeem dat ik bouw volgt het glass-box governance principe: volledige transparantie over wat een AI-agent doet, waarom, en met welk resultaat.

Concreet betekent dit:

- Elke AI-actie wordt gelogd. Niet alleen het eindresultaat, maar het complete beslissingsproces. Via mijn NDJSON receipt ledger is elke stap terug te vinden — precies wat de AI Act vraagt als audit trail.

- Menselijk toezicht zit in het ontwerp. Geen AI-agent die autonoom beslist zonder quality gates. Elk kritiek beslissingsmoment heeft een menselijke checkpoint.

- De architectuur is open source. Iedereen kan controleren hoe het systeem werkt. Dat is het ultieme transparantiebewijs.

Mijn VNX Orchestration systeem staat op GitHub. Iedereen kan de code inzien, controleren hoe beslissingen worden genomen, en verifiëren dat er geen verborgen logica zit. Dat is geen PR-stunt — het is het sterkste transparantiebewijs dat je kunt leveren. Als een toezichthouder vraagt "hoe werkt uw AI-systeem?", wijs ik naar de repository. Geen PowerPoint nodig.

Waarom dit relevant is voor de AI Act

De eisen die de AI Act stelt — documentatie, logging, menselijk toezicht, transparantie — zijn precies de principes die ik al toepas. Niet omdat de wet het eist, maar omdat het de enige manier is om betrouwbare AI-systemen te bouwen.

Als je nu begint met AI, bouw het dan meteen goed. Compliance-by-design is niet duurder dan achteraf repareren — het is goedkoper.

Lees ook: Glass Box Governance: transparantie als fundament voor multi-agent AI — hoe ik mijn eigen AI-systemen inricht voor volledige traceerbaarheid.