Scroll door LinkedIn en je ziet het dagelijks. "Mijn AI agent draait volledig autonoom." "Deze agent vervangt 3 medewerkers." "Full autopilot, geen menselijke tussenkomst nodig." Op TikTok is het nog erger — 60-seconden video's waarin iemand beweert dat je met drie prompts een volledig autonoom bedrijf runt.

De realiteit? 88% van alle AI agents haalt productie niet eens. Niet omdat de technologie niet deugt. Maar omdat mensen fase 1 overslaan en verwachten dat dag 1 eruitziet als maand 6.

Ik weet dat, omdat ik het zelf heb meegemaakt.

De "volledig autonome" leugen

Laat me eerlijk zijn: volledig autonome AI agents bestaan niet. Niet bij mij, niet bij Google, niet bij het hipste AI-startup dat je vorige week op LinkedIn zag.

Wat wél bestaat: systemen die zo goed zijn afgesteld dat het autonoom lijkt. Maar onder de motorkap zit altijd een gradueel proces. Maanden van finetunen, feedback loops, en patroonherkenning voordat het systeem zelfstandig mag beslissen.

Gartner voorspelt dat meer dan 40% van alle agentic AI-projecten wordt geannuleerd vóór 2027. MIT-onderzoek laat zien dat 95% van alle AI-pilots faalt. Niet vanwege slechte modellen. Vanwege slechte verwachtingen.

De bedrijven die wél slagen — zoals Avi Medical met 93% kostenbesparing — hebben één ding gemeen: ze begonnen met de zijwieltjes erop.

Wat ik leerde van 11 agents in productie

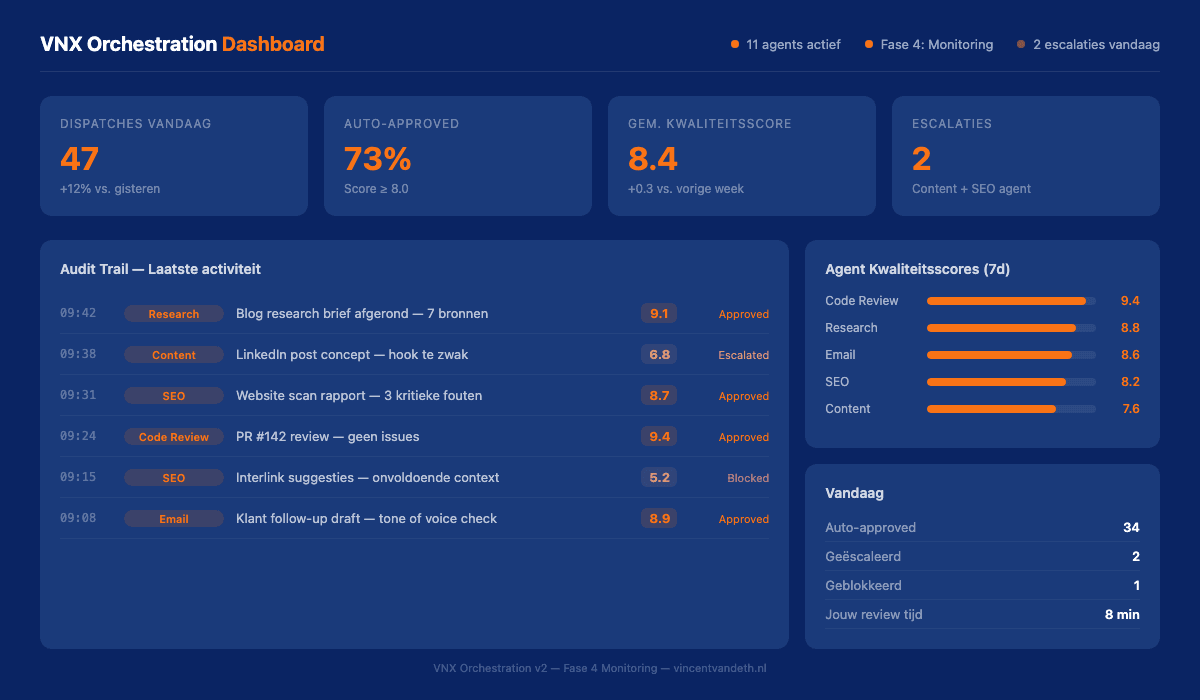

Ik draai VNX Orchestration: 11 AI-agents die dagelijks taken uitvoeren. Van content research tot code reviews, van SEO-analyses tot klantcommunicatie. Ik heb eerder geschreven over wat AI orchestration echt betekent — het is meer dan taken verdelen. Het systeem heeft inmiddels meer dan 3.000 patronen geleerd en draait grotendeels zelfstandig.

Maar zo begon het niet.

De eerste maanden keurde ik elk besluit handmatig goed of af. Elke output ging door een quality gate — een checkpoint waar ik als mens keek: klopt dit? Is dit goed genoeg? Past dit bij wat ik wil?

Dat was frustrerend. Traag. Soms voelde het alsof ik net zo goed alles zelf kon doen. Maar het was noodzakelijk. Want elke goedkeuring en elke afkeuring trainde het systeem. Na honderden beslissingen begon het patronen te herkennen. Na duizenden kon het voorspellen wat ik zou goedkeuren.

Pas toen — na maanden — gingen de zijwieltjes eraf.

📖 Lees ook: Van ChatGPT-prompt naar AI-systeem: waarom 'even AI erbij pakken' niet werkt — het verschil tussen AI gebruiken en AI integreren

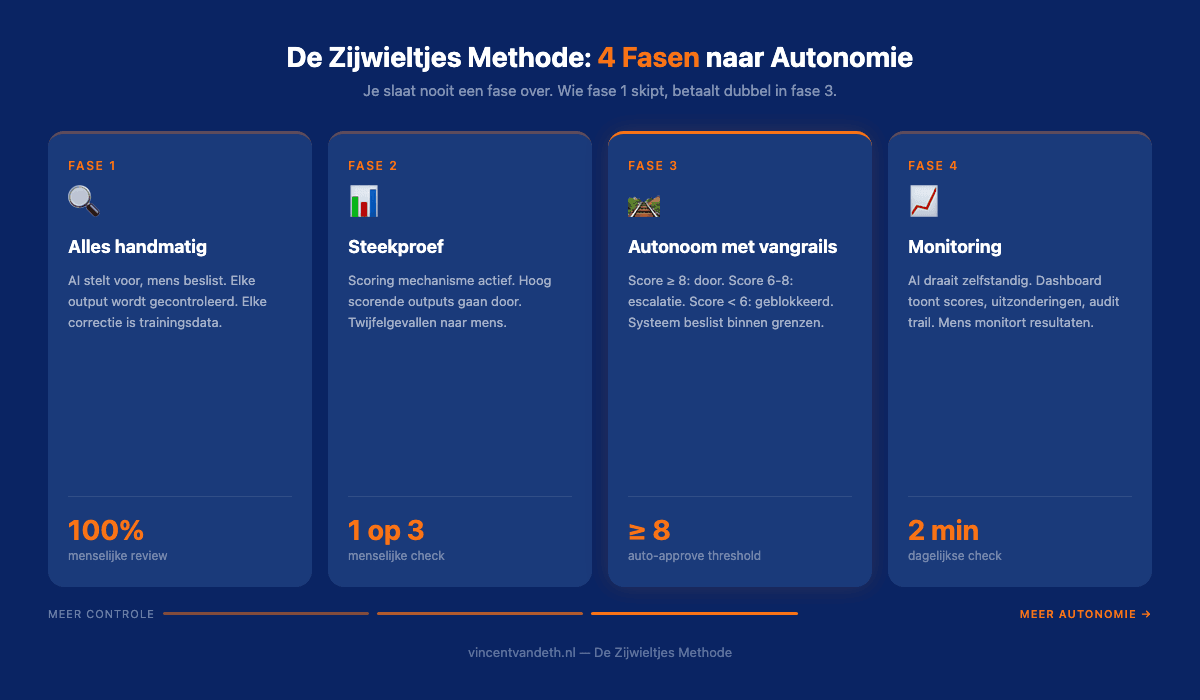

De zijwieltjes methode: 4 fasen

Dit is het framework dat ik gebruik voor mijn eigen systeem én voor klanten. Vier fasen, altijd in deze volgorde. Je slaat er geen over.

Fase 1: Alles handmatig — AI stelt voor, mens beslist

De AI doet het werk, maar jij keurt alles goed. 100% review.

Denk aan een nieuwe medewerker op de eerste werkdag. Je laat diegene niet meteen zelfstandig klanten mailen. Je kijkt mee. Je corrigeert. Je legt uit waarom iets wel of niet kan.

In de praktijk: de AI schrijft een concept-email naar een klant. Jij leest het. Past het aan. Stuurt het. De AI ziet wat je veranderde en leert daarvan.

Dit voelt langzaam. Het ís langzaam. Maar elke correctie is data die het systeem nodig heeft.

Fase 2: Steekproef — AI doet, mens checkt 1 op 3

Na weken (of maanden, afhankelijk van de complexiteit) heb je genoeg patronen opgebouwd. Je hoeft niet meer alles te controleren. Je checkt steekproefsgewijs.

In de praktijk: het systeem heeft een scoring mechanisme. Outputs die hoog scoren (vergelijkbaar met eerder goedgekeurde resultaten) gaan door. Outputs die lager scoren komen bij jou terecht.

Je reviewt misschien nog 1 op de 3 outputs. Niet willekeurig, maar gericht op de twijfelgevallen.

Fase 3: Autonoom met vangrails

Nu wordt het interessant. Het systeem mag zelfstandig beslissen — maar alleen binnen grenzen.

In de praktijk: de AI publiceert content als de kwaliteitsscore 8 of hoger is. Bij een score tussen 6 en 8 escaleert het naar jou. Onder de 6 wordt het geblokkeerd en herschreven.

Die grenzen — de vangrails — zijn het verschil tussen een systeem dat werkt en een systeem dat ontspoort. Zonder vangrails krijg je wat onderzoekers "automation complacency" noemen: blind vertrouwen in een systeem dat fouten maakt zonder dat iemand het merkt.

Fase 4: Monitoring — AI draait, mens kijkt dashboard

Dit is waar het autonoom lijkt. De AI draait. Beslissingen worden genomen. Werk wordt afgeleverd. Maar achter de schermen draait een audit trail die elke beslissing logt.

In de praktijk: ik open 's ochtends een dashboard. Ik zie hoeveel taken zijn afgehandeld, welke scores ze kregen, en of er uitzonderingen waren. Als alles groen is, kost me dat twee minuten. Als er een rode vlag is, duik ik erin.

Dit is geen "full autonomy." Dit is human-on-the-loop — een aanpak verwant aan mens-AI samenwerking die in de gezondheidszorg 54% minder diagnostische fouten oplevert.

Waarom je NOOIT een fase overslaat

De verleiding is groot. "Mijn use case is simpel, ik kan meteen naar fase 3." "Ik heb geen tijd voor maanden handmatig goedkeuren."

Ik snap het. Maar dit is wat er gebeurt als je fase 1 skipt:

Je weet niet wat "goed" eruitziet. Zonder honderden handmatige beoordelingen heeft het systeem geen benchmark. Het optimaliseert voor iets — maar je weet niet waarvoor. Misschien voor snelheid. Misschien voor een patroon dat in 30% van de gevallen fout is.

Je vangrails kloppen niet. In fase 3 heb je thresholds nodig. Welke score is "goed genoeg"? Dat weet je alleen als je in fase 1 en 2 genoeg data hebt verzameld over wat goed en slecht eruitziet.

Je audit trail is waardeloos. Als er iets misgaat in fase 4 — en dat gebeurt — moet je kunnen terugzoeken waar het fout ging. Zonder de data uit eerdere fasen is dat zoeken naar een naald in een hooiberg.

Wie fase 1 skipt, betaalt dubbel in fase 3. Gegarandeerd.

📖 Lees ook: Waarom de helft van het MKB worstelt met AI — 5 concrete stappen om AI wél werkend te krijgen

Hoe ik dit nu toepas op content

Even een concreet voorbeeld. Mijn content pipeline werkt op dit moment zo:

- Research — een AI-agent zoekt bronnen, statistieken, en trends. Ik keur de research brief goed (fase 1 voor dit onderdeel).

- Schrijven — een AI-agent schrijft de blog op basis van de goedgekeurde research. Ik keur de structuur en inhoud goed.

- Validatie — een onafhankelijke AI-agent controleert alle feitelijke claims. Ik bekijk het validatierapport.

- Publiceren — na mijn goedkeuring gaat het live.

Op dit moment zit ik in fase 1-2. Ik keur nog veel handmatig goed. Maar het systeem leert. Elke goedkeuring en elke correctie wordt opgeslagen. Over een paar maanden kan ik overschakelen naar score-based auto-approve voor stappen waar het systeem consistent hoog scoort.

Dat is geen zwakte. Dat is het proces.

"Maar voor simpele taken kan het toch meteen?"

Ja, deels. Er zijn taken waar de risico's laag genoeg zijn om sneller door de fasen te gaan. Data-entry met vaste formats. Spam filtering. Standaard categorisatie.

Maar zelfs daar geldt: je doorloopt de fasen, je slaat ze niet over. Je gaat er alleen sneller doorheen. Fase 1 duurt misschien een dag in plaats van een maand. Maar je doet het wel.

De nuance is belangrijk: ik zeg niet dat autonomie onmogelijk is. Ik zeg dat autonomie een eindpunt is, geen startpunt. En de bedrijven die dat begrijpen — die leveren gemiddeld 171% ROI op hun AI-investering.

Wat dit betekent voor jouw bedrijf

Als je AI agents wilt implementeren in je bedrijf, onthoud dan dit:

Begin klein.Kies één proces. Eén agent. Eén taak. Niet je hele klantenservice op dag 1. Bekijkmijn werkwijze als je wilt zien hoe ik dit aanpak voor klanten.

Begin met zijwieltjes. Laat de AI voorstellen doen, maar beslis zelf. Keur goed. Keur af. Geef feedback. Dit is geen tijdverspilling — dit is de investering die bepaalt of je systeem over drie maanden wél zelfstandig kan draaien.

Bouw een audit trail. Log elke beslissing. Elke goedkeuring. Elke afwijzing. Dit is je verzekering voor als het misgaat — en je bewijs dat het werkt als het goed gaat.

Respecteer de fasen. Fase 1 → 2 → 3 → 4. Geen shortcuts. De bedrijven die 88% failure rate vermijden, zijn de bedrijven die het geduld hebben om het goed te doen.

De LinkedIn-posts over "volledig autonome agents" zijn marketing. De werkelijkheid is minder sexy maar veel effectiever: zijwieltjes erop, maanden trainen, en ze er pas afhalen als het systeem het verdiend heeft.

Dat is geen beperking. Dat is architectuur.