Je marketingmedewerker opent ChatGPT. Typt: "Schrijf een LinkedIn-post over AI in het MKB." Krijgt een tekst van 200 woorden met vijf bullet points. Prima. Volgende dag, dezelfde vraag. Nu krijgt ze een lopend verhaal van 400 woorden. Geen bullets. Totaal andere toon. Ze past het aan, vraagt om het juiste format, krijgt weer iets anders. Na tien pogingen sluit ze het tabblad.

"Dan kan ik het net zo goed zelf doen."

Ik hoor dit verhaal in vrijwel elk gesprek met MKB-ondernemers. Het chatgpt inconsistent resultaat is niet een randverschijnsel — het is de belangrijkste reden waarom medewerkers afhaken. Onderzoek van BlueAvispa bevestigt het: "inconsistency adds to user frustration, it feels like the AI is arbitrary" (2025). En McKinsey rapporteerde in 2025 dat managers gefrustreerd zijn omdat medewerkers AI niet effectief inzetten.

Het probleem is niet dat je team te dom is voor AI. Het probleem is dat ze vastzitten op het verkeerde niveau.

Waarom ChatGPT iedere keer iets anders geeft

Stel je een stagiair voor die elke ochtend binnenkomt zonder herinneringen aan gisteren. Geen idee van je huisstijl. Geen kennis van vorige projecten. Elke dag begin je van voren af aan.

Dat is ChatGPT.

Drie technische oorzaken, vertaald naar wat het voor jou betekent:

1. De creativiteitsknop staat altijd aan. ChatGPT heeft een interne instelling die bepaalt hoe "creatief" het antwoord is. Die staat standaard op een middenstand — net creatief genoeg om variatie te produceren. Resultaat: stel dezelfde vraag twee keer, en je krijgt twee verschillende antwoorden. Niet omdat het beter nadenkt, maar omdat er bewust willekeur is ingebouwd.

2. Geen geheugen tussen sessies. Tenzij je specifiek betaalt en configureert, onthoudt ChatGPT niets. Je tone of voice? Vergeten. Het format dat vorige week wél werkte? Weg. Elke sessie begint met een blanco vel. Dat maakt het onmogelijk om consistentie op te bouwen.

3. Geen vaste instructies. Zonder system prompt of vaste context bepaalt ChatGPT zelf hoe het antwoordt. Het heeft geen richtlijnen over format, lengte, of stijl — tenzij jij die elke keer opnieuw meegeeft. Onderzoek van 7 Minute AI bevestigt: "the difference between a vague question and a clear request becomes even more noticeable."

Het gevolg? Medewerkers die het vertrouwen verliezen. Die ChatGPT als onbetrouwbaar bestempelen. En die terugvallen op handmatig werk — precies het werk dat AI zou moeten versnellen.

Hier een concreet voorbeeld. Dezelfde opdracht, drie keer aan ChatGPT gegeven:

Prompt: "Schrijf een LinkedIn-post over AI voor het MKB."

ChatGPT poging 1: "AI revolutioneert de manier waarop het MKB werkt. Van klantenservice tot marketing, de mogelijkheden zijn eindeloos. Hier zijn 5 manieren waarop jij AI kunt inzetten..." (200 woorden, bullets, enthousiaste toon)

ChatGPT poging 2: "Ik sprak vorige week met een ondernemer die zei: 'AI klinkt mooi, maar wat doet het concreet?' Goede vraag. Want het eerlijke antwoord is..." (400 woorden, verhalend, geen bullets)

ChatGPT poging 3: "3 AI-toepassingen die MKB-bedrijven vandaag al geld besparen: 1) Geautomatiseerde facturenverwerking 2) Slimme klantenservice 3) Content creatie..." (150 woorden, opsomming, zakelijke toon)

Drie totaal verschillende posts. Andere lengte, andere structuur, andere toon. Mijn blog pipeline levert elke keer hetzelfde format: vaste structuur, vaste tone of voice regels, vaste lengtes per sectie. Niet omdat er een mens meekijkt bij elke zin, maar omdat de instructies in het systeem zitten — niet in het hoofd van de medewerker.

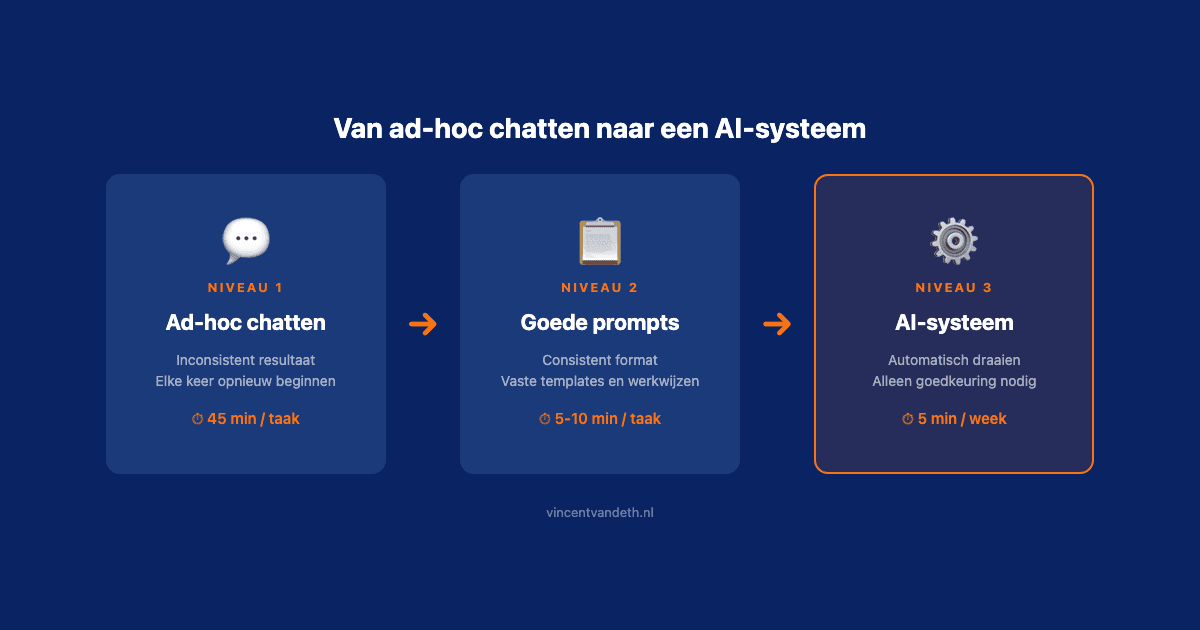

Niveau 1: Ad-hoc chatten (en waarom het niet werkt)

Dit is hoe 90% van de bedrijven AI "gebruikt." Open ChatGPT, tik een vraag, hoop op het beste.

Concreet voorbeeld — een wekelijkse LinkedIn-post:

Je medewerker opent ChatGPT. Typt: "Schrijf een LinkedIn-post over AI." Krijgt een generiek verhaal. Past het vijf keer aan. Nog steeds niet in de juiste toon. Kopiëren, handmatig herschrijven, plaatsen. Totale tijd: 45 minuten. En volgende week hetzelfde circus.

Dit niveau kenmerkt zich door:

- Geen context — ChatGPT weet niets over je bedrijf, doelgroep, of tone of voice

- Geen format — elke keer een ander soort antwoord

- Geen leereffect — volgende sessie begint weer van nul

- Hoge frustratie — medewerkers voelen dat ze tijd verspillen

McKinsey rapporteerde dat bedrijfsleiders gefrustreerd zijn omdat medewerkers hun AI-plannen niet waarmaken (2025). Maar de oorzaak zit niet bij de medewerkers — het zit bij het niveau waarop ze AI gebruiken.

Op Reddit klagen gebruikers over een "measurable, documented decline in ChatGPT's output quality" en "consistent slow response times and ignoring commands." De frustratie is breed gedragen.

Lees ook: Van ChatGPT-prompt naar AI-systeem: waarom 'even AI erbij pakken' niet werkt

Niveau 2: Goede prompts en werkwijzen (het laaghangend fruit)

Het goede nieuws: je hoeft niet elke dag het wiel opnieuw uit te vinden. Met vaste prompt templates en herbruikbare werkwijzen kom je al een heel eind.

Ik sprak een marketingmanager bij een installatiebedrijf met 15 medewerkers. Ze had ChatGPT aangeschaft voor het hele team. Na twee maanden gebruikte niemand het meer. De reden: "Ik moet elke keer opnieuw uitleggen wie we zijn, wat onze toon is, en hoe lang de tekst moet zijn. Tegen de tijd dat het antwoord goed is, had ik het zelf sneller geschreven." Dat is geen ChatGPT-probleem. Dat is een niveau-1-probleem.

Hetzelfde voorbeeld — een wekelijkse LinkedIn-post, maar nu met een template:

In plaats van "Schrijf een LinkedIn-post over AI" gebruik je een vaste template:

"Je bent een LinkedIn ghostwriter voor een AI-architect die MKB-bedrijven helpt. Tone of voice: direct, persoonlijk, geen jargon. Format: sterke opening (max 2 zinnen), 3 concrete bullet points, afsluitende vraag of CTA. Onderwerp: [vul in]. Lengte: maximaal 150 woorden."

Het verschil is enorm. Dezelfde vraag, maar nu met context, format, en tone of voice. Het resultaat is niet perfect, maar het is consistent. Je medewerker hoeft niet meer elke keer opnieuw uit te leggen wat ze wil. Totale tijd: 5 minuten in plaats van 45.

Wat je nodig hebt voor niveau 2:

- Prompt templates per taak — een voor LinkedIn-posts, een voor emails, een voor klantenservice-antwoorden. Bewaar ze in een gedeeld document.

- System prompts — als je ChatGPT Teams of Enterprise gebruikt, stel dan vaste system prompts in per afdeling. Zo kent ChatGPT altijd je basiscontext.

- Voorbeelden meegeven — geef ChatGPT twee of drie voorbeelden van output die je goed vindt. Dat werkt beter dan tien regels uitleg.

- Vaste werkwijze — train je team om altijd de template te gebruiken in plaats van vrij te typen. Maak er een standaardprocedure van.

Voor 80% van de bedrijven is dit al een grote verbetering. Je gaat van willekeurige output naar voorspelbare resultaten. Van frustratie naar bruikbaarheid.

Lees ook: Prompt engineering is dood — context engineering leeft

Niveau 3: Een systeem (van doen naar controleren)

Niveau 2 lost het consistentie-probleem grotendeels op. Maar je medewerker moet nog steeds actief met ChatGPT aan de slag. Elke post, elke email, elk stuk content vereist handwerk.

Niveau 3 draait dat om. In plaats van zelf te doen, controleer je alleen nog.

Hetzelfde voorbeeld — een wekelijkse LinkedIn-post, maar nu als systeem:

Elke maandag genereert het systeem automatisch drie LinkedIn-concepten. Het pakt trending topics bij je doelgroep, past je tone of voice regels toe, en checkt je content kalender om overlap te voorkomen. Je opent Telegram, leest de concepten, en tikt "goedgekeurd" of geeft feedback. Totale tijdsinvestering: 5 minuten per week.

Mijn eigen blog pipeline is een goed voorbeeld van niveau 3 in de praktijk. Elke blogpost doorloopt dezelfde stappen: keyword research, outline, schrijven, SEO-check, interne links, afbeeldingen. De tone of voice regels, de formattering, de SEO-vereisten — dat zit allemaal in het systeem, niet in een prompt die ik elke keer opnieuw typ. Het resultaat: 2.472 dispatches verwerkt met een first-pass success rate van 84,6%. Dat is consistentie die je met losse prompts nooit bereikt.

Ik gebruik dit principe voor mijn eigen blog pipeline. Research, schrijven, afbeeldingen, SEO-optimalisatie, interne links — het systeem doet het werk. Ik controleer het resultaat. Dat is het verschil: van actief produceren naar een controlerende functie.

Wat niveau 3 vereist:

- Workflows — een aaneenschakeling van stappen die automatisch draaien (bijvoorbeeld met n8n, Make, of Zapier)

- Vaste regels — tone of voice, format, kwaliteitscriteria die het systeem altijd toepast

- Menselijke goedkeuring — het systeem produceert, jij keurt goed. Nooit volledig autonoom voor externe communicatie

- Feedback loop — als je iets afkeurt, leert het systeem waarom

Dit is waar AI betrouwbaar maken voor je bedrijf werkelijk begint. Niet door betere prompts te schrijven, maar door een systeem te bouwen dat consistent levert — elke keer, zonder dat iemand het wiel opnieuw uitvindt.

Welk niveau past bij jouw bedrijf?

Niet iedereen hoeft naar niveau 3. Sterker nog: als je nu op niveau 1 zit, is de sprong naar niveau 3 te groot. Begin met niveau 2.

Je zit op niveau 1 als:

- Medewerkers openen ChatGPT zonder vaste werkwijze

- Iedereen promptt op zijn eigen manier

- Er zijn geen templates of richtlijnen

- Output is onvoorspelbaar en inconsistent

Je bent klaar voor niveau 2 als:

- Je team gebruikt AI regelmatig maar zonder structuur

- Je merkt dat dezelfde vragen steeds opnieuw worden gesteld

- Er is bereidheid om werkwijzen vast te leggen

Je bent klaar voor niveau 3 als:

- Niveau 2 werkt goed maar kost nog te veel handwerk

- Je hebt repetitieve taken die wekelijks terugkomen

- Je wilt van "AI gebruiken" naar "AI integreren" in je bedrijfsprocessen

De meeste bedrijven die ik spreek zitten op niveau 1 en denken dat ze naar niveau 3 moeten. Mijn advies: ga eerst naar niveau 2. Dat levert al 80% van de winst op met 20% van de moeite. En het legt de basis voor niveau 3 wanneer je daar klaar voor bent.